Im Bereich AI wird eifrig an immer neuen KI-Modellen geschraubt. Gestern Objekterkennung in Bildern (Classification) und Anomalie-Erkennung, heute Large Language Models und morgen vielleicht ganz was Neues. “Die AI” steckt in erster Linie in den Modellen.

Modelle sind Machine-Learning-Artefakte, die durch Training meist grosser Datenmangen entstehen. Sie werden im Unternehmen zu einem eigenen Wertgegenstand, einem “asset”. Ohne Modell kein KI-basiertes Produkt.

Doch KI-Modelle sind direkt nicht von der bevorstehenden Regulierung durch die “EU KI-Verordnung” betroffen. – Ok, das ist nicht ganz wahr, bestimmte, besonders grosse Modelle sind reguliert, aber eine durchschnittliche Organisation bringt solche Modelle nicht unter die Leute.

Vom Model zum System

In purer Form ist ein frisch trainiertes KI-Modell zwar von Wert, aber nicht alleine nutzbar. Es verhält sich ähnlich wie eine Software: Das Software-Programm muss auf einem Betriebssystem und der dazugehörige Hardware gestartet werden, dies nennt man “Laufzeit” oder “Runtime-Umgebung”. Bei KI nennt sich diese Art der Nutzung “Inferenz”. Das Modell wird gestartet und über eine mehr oder weniger komplexe Ein-/Ausgabe-Schnittstelle nutzbar. Wir kennen zum Beispiel die Chat-Oberflächen der LLMs.

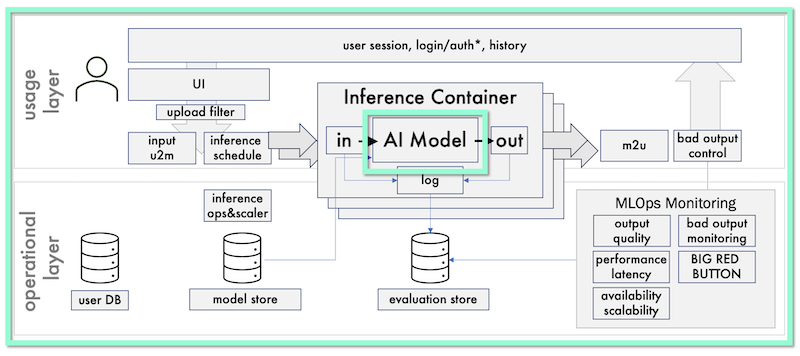

Welchen Umfang das System im Vergleich zum Modell haben kann, illustriert die folgende beispielhafte Architekturskizze, in der das Model nur einen kleinen Teil des Gesamtsystems ausmacht:

Hier liegt das Hauptaugenmerk nicht auf dem Training der KI, sondern der Nutzung. Spätestens bei der Regulierung, aber auch bei Betrachtungen der Betriebskosten steht die Inferenz eines KI-Modells im Vordergrund, auch wenn Anforderungen ans Training gestellt werden.

Zum Inferenz-Zeitpunkt wird aus dem AI Model sowie der Software und Hardware drumherum ein “System”, dass man hoffentlich dann sehr komfortabel nutzen kann. Und dieses System ist dann in der Europäischen Union reguliert, wenn man es Nutzen kann oder vertreibt.

Definition “KI-System” in der KI-Verordnung

Der EU AI Act definiert “KI-System” in Artikel 3, Absatz (1) so:

“KI-System”: ein maschinengestütztes System, das so konzipiert ist, dass es mit unterschiedlichem Grad an Autonomie betrieben werden kann und nach seiner Einführung Anpassungsfähigkeit zeigt, und das für explizite oder implizite Ziele aus den Eingaben, die es erhält, ableitet, wie es Ausgaben wie Vorhersagen, Inhalte, Empfehlungen oder Entscheidungen generieren kann, die physische oder virtuelle Umgebungen beeinflussen können;

Es handelt sich also um die funktionale Gesamtheit, nicht nur um einen Teil. Das Modell selbst wird im AI Act auch betrachtet, aber ebenso die Trainingsdaten, Tests und weitere Aspekte, die die Eigenschaften des KI-Systems wesentlich beeinflussen.

Meiner Einschätzung nach geht die Definition des AI Acts übrigens weit darüber hinaus was wir landläufig als “KI” bezeichnen: Es werden im Prinzip auch “klassische” Machine-Learning-System und regelbasierte Modelle vom AI Act betroffen sein. Genaueres werden hoffentlich die Ausführungsbestimmungen des noch frischen Gesetzes festlegen.

AI als System

In der EU-Definition steht explizite Merkmale eines System: Es verarbeitet Eingaben und generiert Ausgaben wie das für KI-Systeme typisch ist. Ein weiterer Aspekt eines “Systems”: Der Zweck ist definiert, abgrenzbar und es sollte diesen auch erfüllen – nicht mehr, nicht weniger. Übrigens leitet sich aus dem Zweck ja auch ab, ob die AI überhaupt der Regulierung unterliegt und welcher Art, also z.B. “high-risk”. Und das macht als Konsequenz dann viel weniger oder eben auch viel mehr Arbeit um mit der EU-Verordnung konform zu sein.

Zum System gehören weitere Eigenschaften, die das Modell alleine in der Regel nicht erfüllt: Schutz vor unbefugter Nutzung. Verfügbarkeit bei hoher Nutzung, was den Einsatz von mehreren Instanzen desselben Modells nötig machen könnte. Schutz vor ungewollten Eingriffen ins System. Und viele mehr.

Erst wenn wir das KI-System betrachten können wir die Risikobetrachtungen anstellen, die vom der KI-Verordnung vorgehen werden.

Was heißt das für die eigenen KI-Systeme?

Deshalb ist es sinnvoll frühzeitig – vom Anfang des Herstellungsprozesses bis zum Einsatz – das KI-Systems mit entsprechenden Tätigkeiten zu begleiten wie Dokumentation, Checklisten, Archivierung von Trainingsdaten etc. Nur mit diesem ganzheitlichen Blick wird aus einem AI model ein der Regulierung entsprechendes AI System.

Überarbeitete Version vom November 2024